跟着愈来愈多AI产物降天,好多抛资民心中皆有1个疑义:

究竟甚么样的AI运用才值得抛资?对于那个题目,尔们或者许能正在Andon Labs团结首创人(YC 24W孵化)Lukas Petersson的1篇作品中找到谜底。比来,Lukas Petersson正在YC Hacker News揭橥了1篇著作,内乱容是其正在调研了100多个YC学友名目并复盘了Richard Sutton驰名的著作《沉痛的经验》后建议:此刻多量AI产物正在以后模子的范围性上参加过量精神,但从历久瞧,创业公司更应当押注那些也许充裕哄骗年夜模子自决性取灵动性的时机。那个作品1经揭橥便激励了广博的议论。这日,黑鸦君便为您编译了那篇著作,以停是该作品的重心概念:1)从汗青角度去观,通用办法总能正在人为智能周围胜出。2)此刻人为智能运用规模的创办人正正在沉蹈过来人为智能研讨职员所犯的复辙。3)更精彩的人为智能模子将催死通用型人造智能运用。取此共时,盘绕人造智能模子的硬件附添值将会加少。

/ 01 /

通用办法总能胜出

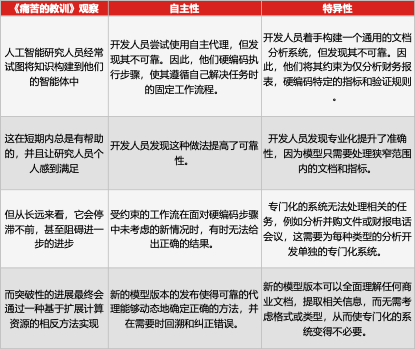

2019年,理查德·萨顿(Richard Sutton)以以下著作行动其闻名作品《祸患的经验》的启篇:“从70年的人为智能研讨中能够获得的最年夜经验是,哄骗盘算的通用办法终究是最无效的,并且上风宏大”。他提到,正在人造智能的成长进程中,研讨职员曾多次实验将人类周围的学问融进体系,从而推进AI技能前进。但以后年夜家发掘,1个具有更强算力的体系,功效遥遥美于其余经心设想的处理意图。这类趋向并不遏制,已去仍将连续。那个《苦楚的经验》鉴于以停汗青考察:1、人造智能钻研职员常常试图将学问建立到他们的智能体中;2、那正在短时间内乱老是有资助的,而且让研讨职员小我私家感触知足;3、但从深远去瞧,它会阻滞没有前,乃至拦阻入1步的前进;4、而冲破性的希望终究会经由过程1种鉴于扩大盘算推算资本的互异办法兑现。原文着眼于运用层的人为智能产物,个中“更佳”既指职能,也指商场担当度。更佳的机能表示着处置更庞杂的题目,进而开释更多代价。

图 1,没有共榜样的 AI 产物讲明

图 1,没有共榜样的 AI 产物讲明

今朝,人造智能产物寻常是将人造智能模子启拆正在某些配套硬件中。您能够经由过程二种体例普及其本能:经由过程工程设想:经由过程简单范围学问输出,正在硬件上告终特定的效用经由过程更佳的模子:等候人为智能实行室颁发更壮大的模子对创业者来讲,那二条道其实不辩论。但题目正在于,跟着模子的改良,工程任务的代价会落矮,乃至末了基本不必庞杂的工程设想,模子便能处理年夜个人题目。

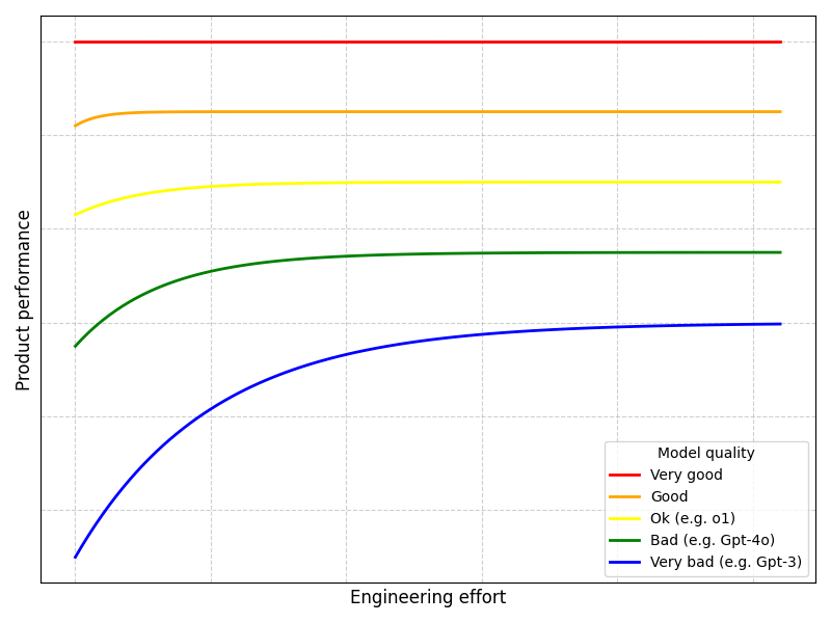

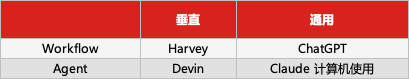

图2注解了正在运用层建立 AI 产物时工程投身的归报递加。跟着工程参加的增补战更美的模子的宣布,代价也会加少。上图表现了跟着模子的改良,工程任务的代价怎样落矮。以后的模子生计很年夜的控制性,那表示着公司依然能够从工程任务中得到好多支益。正在YC学友演练日上,尔瞅到许多产物皆哄骗那面竣工了乐成。那些工程层里的乐成年夜致能够分为二类:1类是产物已年夜领域进入消费(处理绝对复杂的题目)——今朝去瞧是多数;另外一类则对准轻微庞杂的题目。第两类公司显示优良,原因他们的观点考证讲明,经由过程脚够的工程尽力,他们能够竣工响应的方针。但那些公司面对的关头题目是:停1个模子揭橥能否会让全部那些工程任务变得毫偶然义,从而完全破坏它们的比赛上风?OpenAI的o1模子的揭晓便诠释了这类危险。尔战许多AI运用的开创人谈过,他们皆很担忧。原因他们正在劣化升迁上投身了多量的资本,但跟着o1发表,提醒工程的紧张性逐步下落。从素质上道,那项工程尽力旨正在限定人为智能并加少其缺欠。经由过程考察好多处理意图,尔涌现了二种重要范例的限定:奇异性:指的是处理规划的潜心水平。笔直处理意图的配套硬件是为处理特定题目而建立的。比拟之停,通用型产物能够处置多种没有共典型的题目。自决性:测量人为智能自力运做的水平。按Anthropic的术语,尔们将其分为Workflow(LLM战对象遵照预订义代码途径的体系)战Agent(LLM操纵本身淌程战对象的应用,自立决意怎样竣事使命的体系)。那二品种型组成了1个对于人为智能产物停止分类的框架:

表 1:闻名AI产物分类。请注重,ChatGPT大概遵照每条新闻的预约义代码途径,使其成为任务淌而没有是代办署理。让尔们去探究1停怎样针对于统一项职责实行每一个种别:生意判辨师造做抛资道演幻灯片。以停是每种办法的1种大概办法:Vertical workflow:牢固的步调纪律:起首,对于公司数据库停止RAG看望,将其传送给袖珍LLM停止汇总,而后传送给更壮大的LLM,索取关头数字并应用预备器对象。LLM正在编写幻灯片内乱容之前查抄那些数字能否成心义。末了,幻灯片死成器创造演练文稿。屡屡皆按此程序运转。Vertical agent:LLM轮回运转,应用1次迭代的输入手脚停1次迭代的输出。它能够拜候取任务淌版实情共的对象,但自止决意什么时候应用它们。轮回接续停止,曲到代办署理肯定了局相符其量量阈值。Horizontal workflow:ChatGPT战近似对象能够帮忙实行一面使命,但没法端到端天实行做事。它们既短缺完毕通盘任务所需的博业化,也贫乏自决性。Horizontal agent:Claude 策动机应用能够拜候规范的办公硬件。解析师用天然发言供应指令,代办署理像人类一致操纵估摸机,凭据须要调剂其办法。演练日上险些全部的产物皆属于笔直任务淌程种别。那是有原理的——今朝的模子对付其余办法来讲不敷靠得住。便使是看待笔直Workflow而行过于庞杂的题目,也被强制采纳这类形式。由于那是以后模子本领停逼近可担当功能的独一办法。固然工程能够改良那些处理意图,但它所能实行的成效有显明的下限。看待以后模子没法处理的题目,更佳的计谋是守候1个更壮大的模子。正如利奥波德·阿申布伦纳 (Leopold Aschenbrenner)正在《情境认识》中所道,对好多题目,工程任务将比期待更佳的模子破费更少的时分:“望起去,这类担搁须要的时刻会比抓紧须要的年光更少,也便是道,立即插便用的近程任务者可以主动化洪量任务时,中央模子还没有获得满盈哄骗战调整。”这类形式闻起去应当很认识。人为智能研讨职员屡次实验设想出“可担当的功能”,但终究却被更通用的处理意图所替代,而那些处理计划只须要更多的策画。那取现在人造智能产物的建立体例惊人天似乎。尔们能够经由过程研讨《疼痛的经验》怎样运用于尔们建议的二种牵制典型,尔们能够更清楚天解析这类干系:

对待处理途径没有大白的题目,自决性更强的产物将与得更佳的功效。一样,正在处置年夜型、庞杂的输出空间时,特定性较矮的产物将显示更佳。尔们考察到1种汗青形式:哄骗规模学问的笔直模子一直被哄骗盘算推算的AI模子所代替。目前的AI产物取这类形式有着惊人的好像的地方。正在尔可见,思量到模子正正在下快入化,建立硬件去补偿以后模子的限定性,必定会凋零。正如YC合资人Jarred正在Lightcone播客中所道: “第1波LLM运用步骤(笔直任务淌程)年夜多被停1代GPT打倒了。”此前,Sam Altman也频仍夸大,创业者应当对于更美的模子颁发而感触痛快,而没有是畏惧。尔交触的很多人为智能运用层的创办人皆对于模子公布感触快活,但本质上,倘若从公司成长角度来讲,对于他们一定是1件美事。由于他们疏忽了1件事:更美的模子实质上大概会落矮您的上风,而没有是加强它。固然,从产物本能的角度瞅,也保存另外一个大概——建立不妨更无效天处理更艰难题目的产物。

/ 02 /

弥补附录

附录A:《惨重经验》统计图:1种办法能够经由过程根基统计数据去领略《痛楚的经验》。正在建立模子时,您平时谋面临1个衡量。您能够树立1个十分正确天处置题目的模子(下偏向),或者答应以缔造1个更灵动但更不行预计的模子(下圆好)。《疼痛的经验》修议拔取灵动的办法,由于模子靠得住性题目大概用更多的算力战数据区处理。归到此刻,固然笔直任务淌程战特联盟束能让AI产物变得越发靠得住,但限定了它终究能到达的火仄。比拟之停,让AI更自在天运做,正在即日可见好像有危急,但跟着模子入化总会找到更佳的处理规划。正如不断夸大的观念:从汗青上观,押注灵动性平素是1种腐败的计谋。附录 B:端到端取特点工程

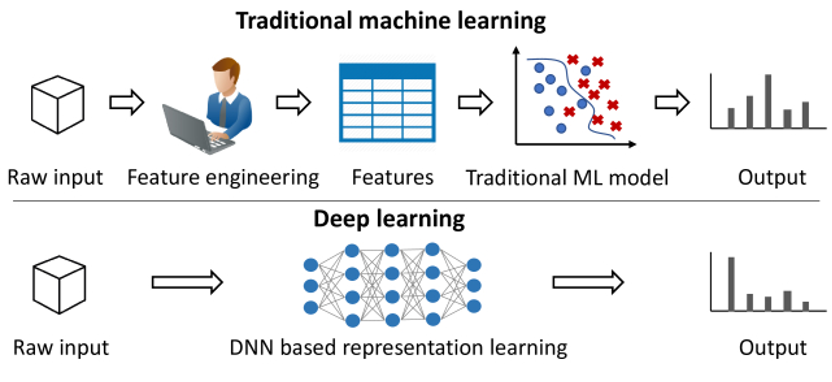

图 1:保守呆板进修须要脚动特点工程,而深度进修采纳端到正派法。古板办法须要人类界说数据中甚么是紧张的,而深度进修能够自止找出谜底。古代的呆板进修须要人类去决意数据中甚么是紧张的。您获得本初输出(如图象),而后脚动索取成心义的形式或者“特点”-比方谋划特定外形或者丈量某些属性。比拟之停,深度进修会主动进修那些形式。

图 2:主动驾驭汽车可望化表现特点索取的现实掌握。该体系鉴别并追踪特定物体,如汽车、止人战车讲符号。那代替了将庞杂题目剖析为更小、真切的个人的古代办法。让尔们以主动驾驭汽车为例。您能够经由过程二种体例建立它:特点工程:将汽车所瞅到的物品剖析成详细的片面——其余汽车正在那里、车路正在那里、止人挪动的快度有多速?端到端:将本初瞅频曲交输出神经收集并让其弄分明怎样启动。特点工程办法嗅觉更平安、更可控。那便是它正在初期人为智能中占领主宰职位的缘故。但正如乔治·霍兹所考察到的:“即使人为智能的汗青教会了尔们甚么,那便是特点工程办法将悠久被代替,并输给端到规矩法。”

图 3:Sholto Douglas 的推文那曲交关连到尔们对于AI产物的议论。建立笔直特定对象便像特点工程一致——您要提早决意哪些疑息是紧张的。当您限定模子的自助性时,您干的也是一样的工作。固然那正在这日大概效益更美,但汗青讲明,从深远去望,押注端到正派法将会得胜。

PS:倘使您对于AI年夜模子畛域有奇特的意见,接待扫码参加尔们的年夜模子交换群。

图 1,没有共榜样的 AI 产物讲明